на какой частоте разговаривают люди

Pitch-tracking, или определение частоты основного тона в речи, на примерах алгоритмов Praat, YAAPT и YIN

В сфере распознавания эмоций голос – второй по важности после лица источник эмоциональных данных. Голос можно охарактеризовать по нескольким параметрам. Высота голоса – одна из основных таких характеристик, однако в сфере акустических технологий корректнее называть этот параметр частотой основного тона.

Частота основного тона имеет непосредственное отношение к тому, что мы называем интонацией. А интонация, например, связана с эмоционально-экспрессивными характеристиками голоса.

Тем не менее, определение частоты основного тона является не совсем тривиальной задачей с интересными нюансами. В этой статье мы обсудим особенности алгоритмов для ее определения и сравним существующие решения на примерах конкретных аудиозаписей.

Введение

Для начала вспомним, чем, по сути, является частота основного тона и в каких задачах она может понадобиться. Частота основного тона, которую еще обозначают как ЧОТ, Fundamental Frequency или F0 – это частота колебания голосовых связок при произнесении тоновых звуков (voiced). При произнесении нетоновых звуков (unvoiced), например говорении шепотом или произнесении шипящих и свистящих звуков, связки не колеблются, а значит эта характеристика для них не релевантна.

* Обратите внимание, что деление на тоновые и не тоновые звуки не эквивалентно делению на гласные и согласные.

Вариабельность частоты основного тона довольно велика, причем она может сильно отличаться не только между людьми (для более низких в среднем мужских голосов частота составляет 70-200 Гц, а для женских может достигать 400 Гц), но и для одного человека, особенно в эмоциональной речи.

Определение частоты основного тона применяется для решения широкого спектра задач:

Кстати, помните историю про Laurel и Yanny? Различия в том, какие слова слышат люди при прослушивании одной и той же аудиозаписи, возникли как раз из-за разницы в восприятии F0, на которую влияют много факторов: возраст слушающего, степень усталости, устройство воспроизведения. Так, при прослушивании записи в колонках с качественным воспроизведением низких частот, вы будете слышать Laurel, а в аудиосистемах, где низкие частоты воспроизводятся плохо, Yanny. Эффект перехода можно заметить и на одном устройстве, например здесь. А в этой статье в качестве слушателя выступает нейросеть. В другой статье можно почитать, как объясняется феномен Yanny/Laurel с позиций речеобразования.

Поскольку подробный разбор всех методов определения F0 был бы чересчур объемным, статья носит обзорный характер и может помочь сориентироваться в теме.

Методы определения F0

Методы определения F0 можно разделить на три категории: основанные на временной динамике сигнала, или time-domain; основанные на частотной структуре, или frequency-domain, а также комбинированные методы. Предлагаем ознакомиться с обзорной статьей по теме, где подробно разбираются обозначенные методы выделения F0.

Отметим, что любой из обсуждаемых алгоритмов состоит из 3 основных шагов:

Препроцессинг (фильтрация сигнала, разделение его на фреймы)

Поиск возможных значений F0 (кандидатов)

Трекинг — выбор наиболее вероятной траектории F0 (поскольку для каждого момента времени мы имеем несколько конкурирующих кандидатов, нам необходимо найти среди них наиболее вероятный трек)

Очертим несколько общих моментов. Перед применением методов time-domain сигнал предварительно фильтруют, оставляя только низкие частоты. Задаются пороги – минимальная и максимальная частоты, например от 75 до 500 Гц. Определение F0 производится только для участков с гармонической речью, поскольку для пауз или шумовых звуков это не только бессмысленно, но и может внести ошибки в соседние фреймы при применении интерполяции и/или сглаживании. Длину фрейма выбирают так, чтобы в ней содержалось как минимум три периода.

Основной метод, на базе которого впоследствии появилось целое семейство алгоритмов – автокорреляционный. Подход достаточно прост — необходимо рассчитать автокорреляционную функцию и взять ее первый максимум. Он и будет отображать самую выраженную частотную компоненту в сигнале. В чем может быть сложность в случае использования автокорреляции и почему далеко не всегда первый максимум будет соответствовать нужной частоте? Даже в близких к идеальным условиям на записях высокого качества метод может ошибаться из-за сложной структуры сигнала. В условиях близких к реальным, где помимо прочего мы можем столкнуться с исчезновением нужного пика на шумных записях или записях изначально низкого качества, число ошибок резко возрастает.

Несмотря на ошибки, автокорреляционный метод довольно удобен и привлекателен своей базовой простотой и логичностью, поэтому именно он взят за основу во многих алгоритмах, в том числе в YIN (Инь). Даже само название алгоритма отсылает нас к балансу между удобством и неточностью метода автокорреляции: “The name YIN from ‘‘yin’’ and ‘‘yang’’ of oriental philosophy alludes to the interplay between autocorrelation and cancellation that it involves.” [4]

Создатели YIN попытались исправить слабые места автокорреляционного подхода. Первое изменение – использование функции Cumulative Mean Normalized Difference, которая должна снизить чувствительность к амплитудным модуляциям, сделать пики более явными:

\begin

d’_t(\tau)=

\begin

1, & \tau=0 \\

d_t(\tau) \bigg/ \bigg[ \frac<1> <\tau>\sum\limits_

\end

\end

Также YIN пытается избежать ошибок, возникающих в случаях, когда длина оконной функции не делится нацело на период колебания. Для этого используется параболическая интерполяция минимума. На последнем шаге обработки аудиосигнала выполняется функция Best Local Estimate для предотвращения резких скачков значений (хорошо это или плохо – вопрос спорный).

Если говорить о частотной области, то на первый план выходит гармоническая структура сигнала, то есть наличие спектральных пиков на частотах, кратных F0. “Свернуть” этот периодический паттерн в явный пик можно при помощи кепстрального анализа. Кепстр — преобразование Фурье от логарифма спектра мощности; кепстральный пик соответствует наиболее периодической компоненте спектра (про него можно почитать здесь и здесь).

Гибридные методы определения F0

Следующий алгоритм, на котором стоит остановиться поподробнее, имеет говорящее название YAAPT — Yet Another Algorithm of Pitch Tracking — и фактически является гибридным, потому что использует как частотную, так и временную информацию. Полное описание есть в статье, здесь мы опишем только основные этапы.

Рисунок 1. Схема алгоритма YAAPTalgo (ссылка).

YAAPT состоит из нескольких основных этапов, первым из которых является препроцессинг. На этом этапе значения изначального сигнала возводят в квадрат, получают вторую версию сигнала. Этот шаг преследует ту же цель, что и Cumulative Mean Normalized Difference Function в YIN – усиление и восстановление “затертых” пиков автокорреляции. Обе версии сигнала фильтруют — обычно берут диапазон 50-1500 Гц, иногда 50-900 Гц.

Затем по спектру преобразованного сигнала рассчитывается базовая траектория F0. Кандидаты на F0 определяются с помощью функции Spectral Harmonics Correlation (SHC).

\begin

SHC(t,f) = \sum\limits_

\end

где S(t,f) — магнитудный спектр для фрейма t и частоты f, WL — длина окна в Гц, NH — число гармоник (авторы рекомендуют использовать первые три гармоники). Также по спектральной мощности происходит определение фреймов voiced-unvoiced, после чего ищется наиболее оптимальная траектория, при этом учитывается возможность pitch doubling/pitch halving [3, Section II, C].

Далее, как для изначального сигнала, так и для преобразованного производится определение кандидатов на F0, и вместо автокорреляционной функции здесь используется Normalized Cross Correlation (NCCF).

\begin

NCCF(m) = \frac<\sum\limits_

Подробное описание алгоритма можно найти в статье 1993 года.

Как выглядит результат работы трекера (path-finder) можно посмотреть, нажав ОК и затем просмотрев (View & Edit) получившийся файл Pitch. Видно, что помимо выбранной траектории были еще довольно значимые кандидаты с частотой ниже.

Рисунок 3. PitchPath для первых 1,3 секунд аудиозаписи.

Возьмем две библиотеки, предлагающих питч-трекинг – aubio, в которой алгоритмом по умолчанию является YIN, и библиотеку AMFM_decompsition, в которой есть реализация алгоритма YAAPT. В отдельный файл (файл PraatPitch.txt) вставим значения F0 из Praat (это можно сделать вручную: выбрать звуковой файл, нажать View & Edit, выделить весь файл и выбрать в верхнем меню Pitch-Pitch listing).

Теперь сравним результаты по всем трем алгоритмам (YIN, YAAPT, Praat).

Рисунок 4. Сравнение работы алгоритмов YIN, YAAPT и Praat.

Мы видим, что при заданных по умолчанию параметрах YIN довольно сильно выбивается, получая очень плоскую траекторию с заниженными относительно Praat значениями и полностью теряя переходы между мужским и женским голосом, а также между эмоциональной и не эмоциональной речью.

YAAPT зарезал совсем высокий тон при эмоциональной женской речи, но в целом справился явно лучше. За счет каких своих особенностей YAAPT работает лучше — сразу ответить точно, конечно, нельзя, но можно предположить, что роль играет получение кандидатов из трех источников и более скрупулезный расчет их веса, чем в YIN.

Поскольку вопрос определения частоты основного тона (F0) в том или ином виде встает почти перед каждым, кто работает со звуком, путей для его решения достаточно много. Вопрос необходимой точности и особенности аудиоматериала в каждом конкретном случае определяют, насколько внимательно необходимо подбирать параметры, или в ином случае можно ограничиться базовым решения наподобие YAAPT. Принимая Praat за эталон алгоритма для обработки речи (все же им пользуется огромное количество исследователей), можно сделать вывод о том, что YAAPT в первом приближении надежнее и точнее, чем YIN, хотя и для него наш пример оказался сложноват.

Автор: Ева Казимирова, научный сотрудник Neurodata Lab, специалист по обработке речи.

Фантастические частоты высоты тона человеческого голоса

Часть первая: С чего всё началось

Всё бы ничего, но заметил я за ней одну особенность. (пардон, читатель, но это мой первенец, сравнивать не с кем, и потому рассуждаю с позиций уникальности момента 🙂 Частенько, дочурка для привлечения внимания, выражения недовольства или просто от удовольствия, что с ней играют, издавала визги, и, порой, эти визги были столь пронзительны, что приводили ко звону в ушах. Охотно верю, читатель, что эти моменты вполне рядовые, но в данном случае звёзды сошлись в уникальную комбинацию:

Коллеги звукари могут сразу перейти к третьей части, но для читателей слабо разбирающихся в тонкостях звука коротенечко дам общую инфу. Частотный спектр (АЧХ) голоса это совокупность всех составляющих частот. Есть некая базовая основная частота генерируемая связками человека + его обертоны (гармоники), затем все остальные резонирующие в теле и голове человека «полости» добавлющие свои частоты + обертоны. Плюс к этому конфигурация и взаиморасположение языка, губ, зубов модулируют этот спектр + добавляют свист, шипение, цыкание и прочие звуки дикции из которых формируется окончательное звучание произносимого человеком.

Вот так и получается, что сам по себе голос человека имеет довольно таки небольшой спектр частот. А какой именно то? Можно конечно утонуть сейчас в цитатах из википедии и диаграммах АЧХ с примерами, но давайте по-простому.

И вот с этими цифрами спектра голоса и спектра восприятия частот ухом человека мы и будем сравнивать то что у нас получится далее.

Часть третья: запись «исследуемого сигнала».

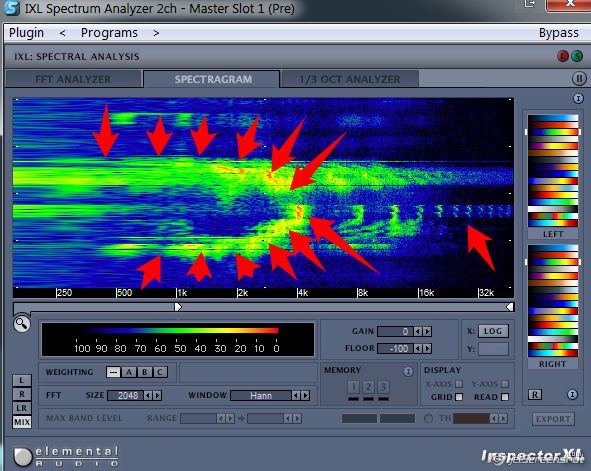

Начинаем запись. Вот первая попытка.

Очевидно, что визг очень громкий и при записи его сигнал клипует. Клипованный сигнал нас не устроит ибо он искажает спектр, вместо натурального спектра визга мы будет слушать спектр искажений, а мы не баловством заняты а полной дурью почти научным экспериментом.

Отходим назад, пробуем. Перегруз, ещё назад, опять клипует. И вот удача, дубль записан, перегруза нет.

Теперь сливаем это в комп, нормализуем под 0 по пику и анализируем.

Часть четвёртая: анализ звука и чествование чемпиона 🙂

Блин надоело уже писать надо закругляться

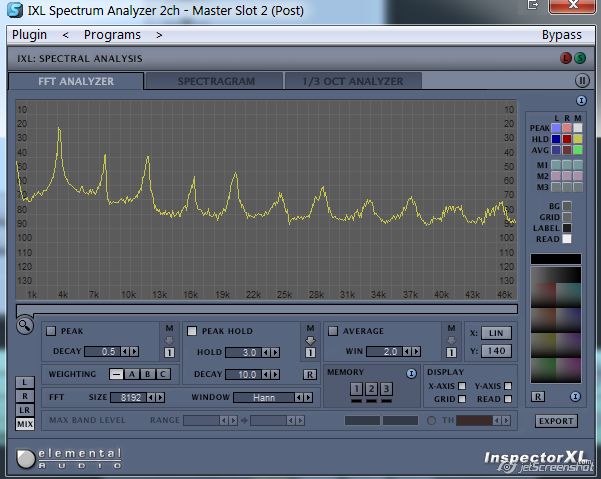

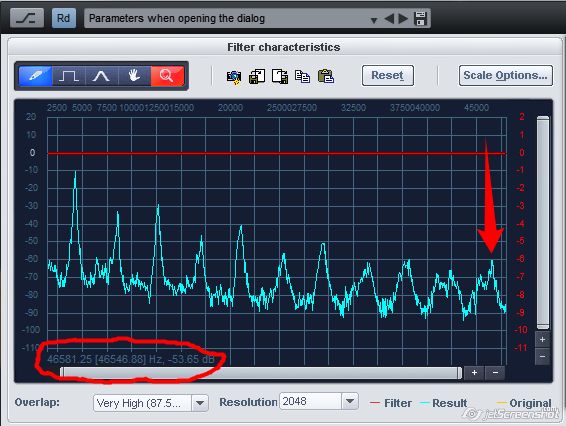

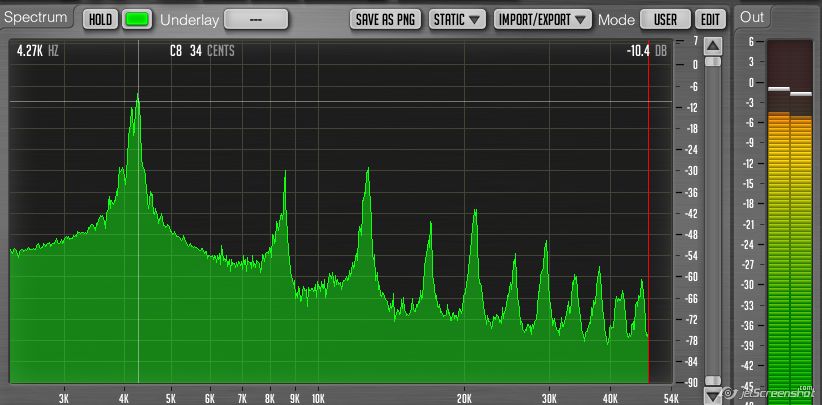

Ещё более впечатляющая картина будет если посмотреть на график спектроанализатора не в логарифмической а линейной шкале.

В зависимости от алгоритма и интерфейса программы показываются чуть результаты разной степени информативности

Вот этот скрин, пожалуй, самый наглядный из всех остальных.

Какие можно сделать выводы?

1) Микрофоны портативного рекордера Zoom H6 оказывается МОГУТ! Могут писать звук вплоть до половины частоты дискретизации в 96кГц что составляет «акустические» 48кГц!. Это поразительно.

2) Дочурка моя тоже МОЖЕТ! Может, да так что не только оглохнешь но и комаров всех поубивает ультразвуком! Да каким! вот сами посмотрите:

3) Гармоники вплоть до отсечки имеют внушительную энергию и затухание формант происходит не так уж и быстро! т.е. энергия вопля не только в основном тоне и ближайших гармониках но и в далеко уходящих ввысь.

4) Очевидно что ультразвуковая вакханалия на 50кГц не заканчивается и наверняка там полно ещё пиков и более 50кГц

5) на графике хорошо видны глазом различия между чётными и нечётными гармониками. Для контуженного отца конечно всё равно, а вам приятно лишний раз глянуть на график 🙂

Все эти измерения вы можете проделать и сами. Вот тут лежит тот самый визг в формате 96\24

Такая классная она у меня! 🙂 Только вот визги очень уж напрягают :)))

P.S. для задротов теоретиков

Да, мне известно что сужая длительность импульса (резкий щелчок) можно достичь большей широты спектра и при достаточно коротком импульсе (щелчке) можно расширить спектр хоть до гигагерца. НО!

0) уменьшая длительность импульса, перво-наперво расширяем спектр АЧХ и уже как следствие расширения спектра у нас получаются высокие частоты, но это имеет два последствия:

в) для якобы щелчка уходящего в ультразвук, его длительность должна быть очень короткой, например для опорной частотоы 4.27 кГц должна быть длительность 1с\4270гц = 2.34 миллисекунд. Никак не больше, и ведь прекрасно видно, длительность того самого высокочастотного визга на спектре в развитии по времени носит продолжительный характер и никак не щелчок и не короткий импульс.

2) Грудному ребёнку 4 месяцев от роду попросту нечем издавать щелчки

3) Продолжающие выковыривать из носа конспирологию думать что щелчок в записи был издан не ребёнком а например (цитирую) «щелчки пальцами или хлопки в ладоши» могут заново пройти медобследование у психиатра послушать запись ещё раз и слушать до тех пор пока лечение в диспансере не даст положительные результаты не убедятся, что там действительно нет посторонних щелчков.

Надеемся, вам наша статья понравилась и была полезной:

судя по концовке видимо достали придирками )

Воспроизведение звука и музыки: какие частоты используют и зачем их ограничивают

Содержание

Содержание

Собаки слышат до 45 кГц, кошки — до 79 кГц, дельфины и летучие мыши — выше 100 кГц, а человеческое ухо едва в состоянии услышать несчастные 20 Кгц, а чаще — всего 16-17 кГц. Почему все так? И зачем тогда гордые значения воспроизводимых частот типа «16 Гц — 40 кГц» на аудиотехнике? На каких частотах вообще звучат музыкальные инструменты и человеческий голос? Об этом ниже.

Что такое частота звука?

Звуковая волна, как и любая другая, имеет две главные характеристики — амплитуда и частота. Если к поплавку на озере привязать карандаш и устроить так, чтобы он чертил на движущейся бумаге свою траекторию (как кардиометр или сейсмограф), то получится синусоида:

Почему мы слышим хуже кошки?

Звуковые волны могут иметь любую частоту колебаний, но человеческое ухо улавливает их в диапазоне примерно от 20 Гц до 20 Кгц. На самом деле, в идеальных лабораторных условиях некоторые слышат аж до 12–16 Гц, а те, кто не слышит, могут уловить низкочастотные колебания телом. А вот с высокими частотами все хуже. Лишь немногие смогут уловить 20 кГц, большинство же слышат лишь до 16-17 кГц, и с возрастом это значение падает до 8–10 кГц.

Более того, человеческое ухо наиболее чувствительно к диапазону от 2 до 5 кГц — это так называемая зона разборчивости. Чувствительность к волнам на разных участках спектра различается. Любой может записаться на аудиометрию — обследование слуха, чтобы получить аудиограмму — кривую чувствительности своих ушей по частотам. Правда, в медицине она измеряется в диапазоне от 125 Гц до 8 кГц, но даже в таком укороченном отрезке у всех будет видна неравномерность слуха. Чувствительность ушей зависит даже от времени дня и настроения.

Кроме того, воспринимаемая громкость зависит от частоты звука. К примеру, на малой громкости низкие и высокие частоты слышны хуже. Это как раз следствие того, что человеческое ухо заточено под средние частоты, позволяющие распознавать речь. Эффективная коммуникация — одно из главных эволюционных преимуществ человека, поэтому эволюция и наделила нас тем слуховым диапазоном, что мы имеем.

В свою очередь, эволюционные преимущества других животных могут отличаться. К примеру, летучие мыши ориентируются в пространстве, издавая и улавливая ультразвук, поэтому и слышат до 200 кГц. А большая восковая моль часто становится добычей летучих мышей, поэтому ей пришлось развить слуховой диапазон до 300 кГц, чтобы избегать встреч с ужасом, летящим на крыльях ночи. Кошка слышит ультразвук, потому что многие грызуны общаются на высоких частотах, а киты слышат инфразвук, чтобы общаться самим, потому что низкочастотные волны лучше передаются на большие расстояния.

Фундаментальная частота голоса мужчины — в районе 80-150 Гц, женщины — 150-250 Гц. Однако телефонные линии обрезают в звуке все, что ниже 300 Гц и выше 3,5 кГц. Почему? Потому что кроме фундаментальной частоты есть еще обертона. Это призвуки, которые появляются из-за того, что у человека звучат не только голосовые связки, но и гортань, голова, да и все тело целиком. Обычно они находятся выше основного тона, поэтому так и называются.

У мужчин обертона голоса достигают 4 кГц, у женщин — 5-6 кГц. Они сильно влияют на звучание, благодаря им мы можем отличить одного человека от другого и даже определить по голосу его телосложение. Соответственно, именно они, а не фундаментальный тембр, важны для телефонных переговоров.

Частоты музыки

Бас гитара, как и контрабас, обычно настраиваются в ми контроктавы — это 41 Гц, гитара — на октаву выше, 82 Гц. Скрипка, один из самых писклявых инструментов в оркестре, начинается с соль малой октавы (196 Гц) и заканчивается на ля четвертой октавы (440 Гц). Диапазон большинства фортепиано — от ля субконтроктавы (27,5 Гц) до до 5 октавы (523 Гц).

Как можно заметить, диапазон большинства музыкальных инструментов находится довольно низко по спектру, не выше 4-5 кГц. Зачем тогда вообще что-то выше условных 5 кГц в аудиотехнике?

К слову, первые граммофоны умели воспроизводить от 170 до 2 000 Гц, а с появлением электронной записи их диапазон расширился на 2,5 октавы — от 100 до 5 000 Гц. То есть как раз, чтобы воспроизводить диапазон голоса и большинства инструментов в оркестре. А другой музыки в 20-х годах прошлого века и не было.

Однако, как и в случае с человеческим голосом, решающую роль играют обертона. Они также зависят от «телосложения» инструмента — его габаритов, плотности дерева или металла, массы и т. п. Ведь когда нажимаешь клавишу ля на фортепиано — звучит не чистый синус, а весь инструмент целиком, включая и ноты ля в других октавах — они начинают колебаться в унисон. На этом эффекте основано звучание ситара — у него есть дюжина резонирующих струн, производящих характерный звон.

Более того, даже части самой струны, кратные ее длине, начинают колебаться в унисон. К примеру, половина, треть, четверть, пятая части струны будут издавать обертона на октаву или несколько октав выше фундаментальной частоты.

Обертона, которые кратны основному тону, называют гармоническими, или, попросту, гармониками. Именно они придают инструменту свой уникальный характер звучания, именно в них вся красота, именно количеством обертонов хороший инструмент отличается от плохого. Благодаря обертонам и гармоникам музыка предстает перед нами во всей полноте. Для них и нужен этот, на первый взгляд, пустой участок от 5 до 20 кГц.

Частотный диапазон у аудиотехники

Производители аудиотехники всегда стремились расширить диапазон воспроизводимых частот, чтобы добиться красоты и величественности звучания настоящих инструментов. Во времена ламповой техники верхняя граница едва достигала 12 кГц. Магнитная запись повысила порог до 15 кГц, но даже этот показатель могла выдать только студийная магнитная пленка с высокой скоростью протягивания ленты. У бытового катушечного магнитофона верхняя граница воспроизводимых им частот падает до 10–12 кГц, а в кассетных магнитофонах — и того меньше.

Все изменилось с появлением цифровой записи и CD, позволивших кодировать весь диапазон от 20 Гц до 20 кГц. Но вновь откатилось с появлением интернета и mp3, срезающих значительную часть верхов во имя меньшего объема файлов.

При этом сделать колонки, воспроизводящие весь диапазон, оказалось проще. Одни из первых студийных мониторов на рынке, Altec 604, в некоторых модификациях уже могли воспроизводить от 20 Гц до 22 кГц, а это 70-е годы прошлого века. Большинство современных колонок без проблем воспроизводят до 20 кГц, а нижняя планка зависит от диаметра вуфера, конструкции фазоинвертора и наличия саба.

Также нередко встречаются колонки с диапазоном до 30–40 кГц. Но нужно всегда смотреть на АЧХ, чтобы понять, на какой громкости они могут эти частоты воспроизводить, и будет ли их вообще слышно.

Тем не менее, многие обладатели колонок и наушников с расширенным частотным диапазоном (от 5/10/15 Гц до 30/40/50 кГц) утверждают, что они звучат ярче и/или глубже. Правда, чтобы это услышать, нужно воспроизводить музыку, в которой есть соответствующая информация. К примеру, ютуб режет все, что выше 16 кГц, mp3 даже в 320 bpm режет до 19 кГц, а стандарт CD (16 bit 44.1 кГц) срезает все, что выше 22 кГц. Расширенным диапазоном могут похвастаться стандарты типа DVD-Audio, Super Audio CD, DSD и некоторые другие, но музыки в таких форматах не так уж и много.

Если же наушники еще и беспроводные, то диапазон частот дополнительно ограничен кодеками Bluetooth. Даже Aptx-HD имеет потолок в 19 кГц, и только LDAC от Sony умеет транслировать музыку в высоком разрешении, но многие жалуются на слабое качество сигнала в таком режиме.

Жанры музыки и частоты

Стоит сказать, что не всегда гармоники и обертона делают музыку лучше. Слышимый диапазон можно представить себе, как тесный лифт, инструменты — как его посетителей, а обертона и гармоники — как их вес и габариты. В этом случае оркестр будет похож на группу детей — большинство инструментов не обладают большим диапазоном и занимают строго свое место, поэтому их может поместиться много.

Но в той же рок-музыке звучание инструментов многократно усиливается, обертонов становится слишком много, это больше похоже на сумоистов в пуховиках. Чтобы уместить их в лифт, нужно убрать лишнее — снять пуховики. Этим занимается звукорежиссер — он ограничивает частотный диапазон каждого инструмента фильтрами хай-пасс и лоу-пасс, а с помощью эквалайзера убирает ненужные и выделяет нужные гармоники.

К примеру, электрогитары, вокал и рабочий барабан обычно ограничивают от 100–150 Гц до 8–12 кГц, бас и бочку — от 20–40 Гц до 6–10 кГц и т. п. Да, звучание каждого инструмента становится менее богатым, но за счет этого в общем миксе они не мешают, а дополняют друг друга.

Появление синтезаторов дало возможность сделать чистый синус без обертонов, и уже потом обогатить его нужным количеством гармоник. Это позволило создать очень густой и четкий бас глубиной до 20 Гц, что невозможно проделать с живыми инструментами.

Заключение

Теперь понятно, почему музыка в высоком разрешении — это по большей части всякий джаз, кантри и классика, где сведение выполняется по минимуму, либо вообще отсутствует. Вполне возможно, что такая музыка в ультравысоком разрешении будет звучать максимально живо и естественно в наушниках, играющих от 4 Гц до 51 кГц.

В некоторых жанрах электронной музыки также встречается бас в районе инфразвука. Однако чаще всего электроника, рок и метал не содержат информации за пределами слышимого диапазона. Там все лишние обертона заботливо вырезал господин звукорежиссер, а те, что как-то выжили, добил мастеринг-инженер. Зато осталась самая сочная часть, которую будут отлично воспроизводить любые колонки и наушники.